Ramsay Santé Optimise ses Opérations avec Novelis

Le 8 octobre 2024, Novelis participera au Salon de l’Intelligence Artificielle de la Direction de la Transformation Numérique du Ministère de l’Intérieur.

Cet événement, situé au Bâtiment Bercy Lumière à Paris, vous plongera dans le monde de l’IA à travers des démonstrations, des stands interactifs et des ateliers immersifs. C’est l’occasion idéale de découvrir les dernières avancées technologiques qui transforment nos organisations !

Nous vous invitons à venir découvrir comment Novelis révolutionne la manière dont les entreprises capitalisent sur leur savoir-faire et partagent leurs connaissances grâce à l’IA Générative. Sur notre stand, nous mettrons en lumière les enjeux et solutions autour de la transmission fiable et efficace des informations au sein des organisations.

Nos experts El Hassane Ettifouri – Directeur Innovation, Sanoussi Alassan – Docteur en IA et expert en GenAI et Laura Minkova – Data Scientist, seront présents et partageront leurs expertises sur comment l’IA peut transformer votre organisation.

Ne ratez pas l’occasion et venez échanger avec nous pour améliorer l’efficacité de votre entreprise !

![[Webinar] Éliminez les approximations de vos initiatives d’automatisation intelligente avec l’intelligence des processus](https://novelis.io/wp-content/uploads/2024/09/FR-1.png)

Avez-vous du mal à savoir comment lancer ou optimiser vos efforts d’automatisation intelligente ? Vous n’êtes pas seul. De nombreuses organisations rencontrent des difficultés à déployer efficacement les technologies d’automatisation et d’IA, gaspillant souvent du temps et des ressources. La bonne nouvelle est qu’il existe un moyen d’éliminer les approximations du processus : Process Intelligence

Rejoignez-nous le 26 septembre pour un webinaire exclusif avec notre partenaire ABBYY, intitulé « Éliminez les approximations de vos initiatives d’automatisation intelligente grâce à l’intelligence des processus ». Au cours de cette session, Catherine Stewart, Présidente des Amériques chez Novelis, partagera son expertise sur la manière dont les entreprises peuvent utiliser le « process mining » et le « task mining » pour optimiser les flux de travail et obtenir un impact réel et mesurable.

Pourquoi assister

L’automatisation a le potentiel de transformer vos opérations commerciales, mais sans la bonne approche, les efforts peuvent facilement échouer. Catherine Stewart s’appuiera sur sa vaste expérience dans la gestion des initiatives d’automatisation pour révéler comment l’intelligence des processus peut aider les entreprises à améliorer leur efficacité, réduire les goulets d’étranglement et garantir un succès à long terme.

Points clés :

Découvrez la première version de notre publication scientifique « Optimisation des agents d’interface utilisateur graphique pour l’ancrage des instructions visuelles utilisant des systèmes d’Intelligence Artificielle multimodale » publiée dans arxiv et soumise à la revue Engineering Applications of Artificial Intelligence. Cet article, rédigé en anglais, est déjà disponible au public.

Merci à l’équipe de recherche de Novelis pour leur savoir-faire et leur expertise.

Most instance perception and image understanding solutions focus mainly on natural images. However, applications for synthetic images, and more specifically, images of Graphical User Interfaces (GUI) remain limited. This hinders the development of autonomous computer-vision-powered Artificial Intelligence (AI) agents. In this work, we present Search Instruction Coordinates or SIC, a multi-modal solution for object identification in a GUI. More precisely, given a natural language instruction and a screenshot of a GUI, SIC locates the coordinates of the component on the screen where the instruction would be executed. To this end, we develop two methods. The first method is a three-part architecture that relies on a combination of a Large Language Model (LLM) and an object detection model. The second approach uses a multi-modal foundation model.

arXiv est une archive ouverte de prépublications électroniques d’articles scientifiques dans différents domaines techniques, tels que la physique, les mathématiques, l’informatique et bien plus encore, gratuitement accessible par Internet.

L’événement Chief AI Officer USA Exchange, prévu pour les 1er et 2 mai 2024, est un rassemblement exclusif, sur invitation uniquement, qui se tiendra à l’hôtel Le Méridien Dania Beach à Fort Lauderdale, en Floride. Conçu pour les cadres dirigeants, il vise à simplifier les complexités de l’Intelligence Artificielle.

Le monde de l’IA évolue à un rythme sans précédent, offrant des opportunités précieuses tout en présentant des défis significatifs. Dans ce paysage complexe, le rôle de cet événement devient crucial pour guider les entreprises à travers les subtilités de l’IA, en maximisant ses bénéfices, le tout en naviguant prudemment pour éviter les pièges éthiques et les préoccupations liées à la vie privée.

Un événement unique auquel Novelis participe

Novelis se distingue en tant qu’expert en Automatisation et IA Générative, possédant une expertise dans l’intégration synergique de ces deux domaines. En fusionnant notre connaissance approfondie de l’automatisation avec les dernières avancées en IA Générative, nous offrons à nos partenaires et clients une expertise inégalée, leur permettant de naviguer avec confiance à travers l’écosystème complexe de l’IA.

Novelis sera représentée par Catherine Stewart, Présidente et Directrice Générale pour les Amériques, ainsi que par Paul Branson, Directeur des Solutions Techniques.

Cet événement offre l’occasion de découvrir les rôles émergents dans l’IA, discuter d’études de cas pertinentes et de stratégies éprouvées pour une intégration réussie de l’IA en entreprise.

Retrouvons-nous pour discuter de vos projets d’IA et d’Automatisation.

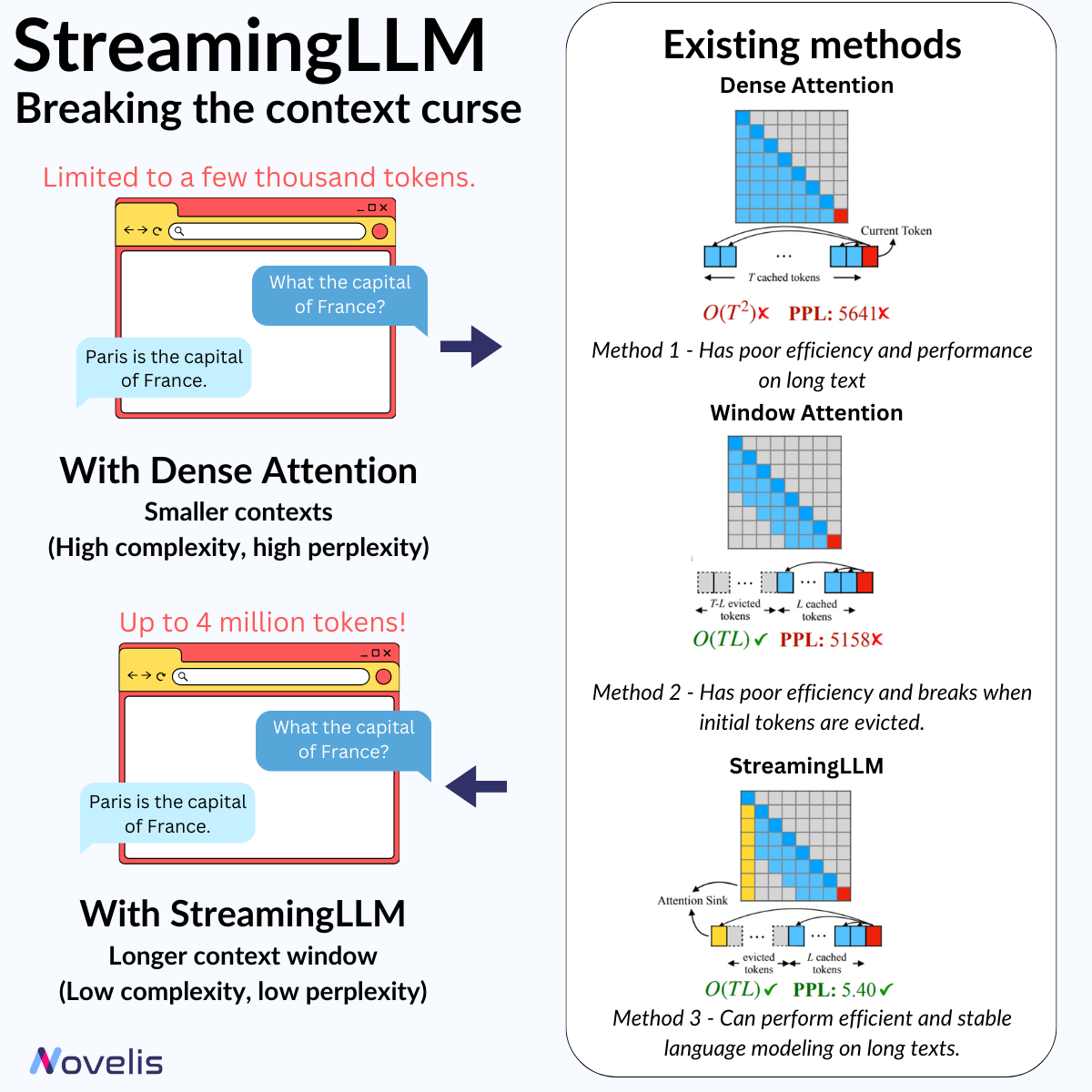

StreamingLLM : briser la limitation de contexte court

Avez-vous déjà eu une conversation prolongée avec un chatbot (comme ChatGPT), pour vous rendre compte qu’il a perdu le fil ou n’est plus aussi cohérent ? Ou vous êtes-vous retrouvé face à une limite de longueur d’entrée épuisée avec les API de certains fournisseurs de modèles de langage ? La principale contrainte des LLM est la longueur de contexte limitée, ce qui empêche des interactions prolongées et de tirer pleinement parti de leurs capacités.

Des chercheurs du MIT, de Meta AI et de l’université Carnegie Mellon ont publié un article intitulé « Efficient Streaming Language Models With Attention Sinks ». Cet article présente une nouvelle technique permettant d’augmenter la longueur d’entrée des LLM sans perte d’efficacité ni dégradation des performances, et ce, sans avoir à réentraîner les modèles.

Le cadre StreamingLLM stocke les quatre premiers jetons (appelés « sinks ») dans un cache KV en tant que « Attention Sink » sur des modèles pré-entraînés comme LLaMA, Mistral, Falcon, etc. Ces jetons essentiels résolvent les défis de performance liés à l’attention classique, permettant d’étendre les capacités des LLM au-delà des limites de taille de contexte et de cache. L’utilisation de StreamingLLM aide à réduire la perplexité (indicateur de la capacité d’un modèle à prédire le prochain mot dans un contexte) ainsi que la complexité de calcul du modèle.

Pourquoi est-ce important ? Cette technique permet aux LLM de gérer des séquences de plus de 4 millions de jetons sans réentraînement, tout en minimisant la latence et l’empreinte mémoire par rapport aux méthodes précédentes.

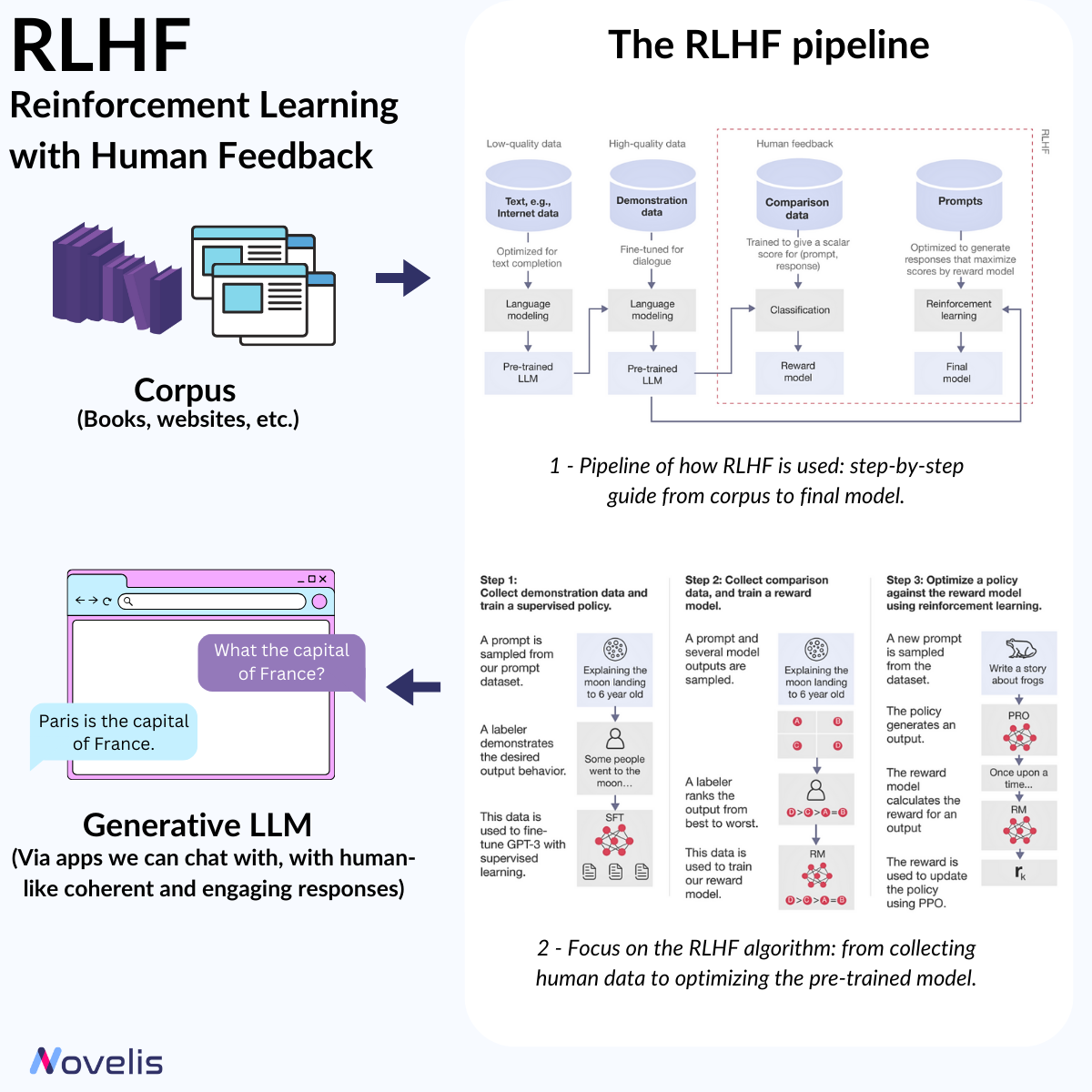

Renforcer l’IA avec l’apprentissage par renforcement à partir du feedback humain

Le Renforcement par l’Apprentissage de Retours Humains (RLHF) est une avancée importante dans le traitement du langage naturel (NLP). Il permet d’ajuster les modèles de machine learning en utilisant l’intuition humaine, rendant les systèmes d’IA plus contextuels. Le RLHF est une méthode d’apprentissage où les modèles d’IA (ici, les LLM) sont affinés via des feedbacks humains. Cela implique de créer un « modèle de récompense » basé sur des retours, qui sert ensuite à optimiser le comportement de l’agent IA par le biais d’algorithmes de renforcement. En pratique, le RLHF permet aux machines d’apprendre et de s’améliorer grâce aux jugements des évaluateurs humains. Par exemple, un modèle d’IA peut être formé pour générer des résumés convaincants ou engager des conversations plus pertinentes en utilisant le RLHF.

Pourquoi est-ce essentiel ? Comprendre le RLHF est crucial pour saisir l’évolution du NLP et des LLM, et comment ils offrent des réponses claires et engageantes. RLHF permet d’aligner les modèles d’IA sur les valeurs humaines en fournissant des réponses plus proches de nos préférences.

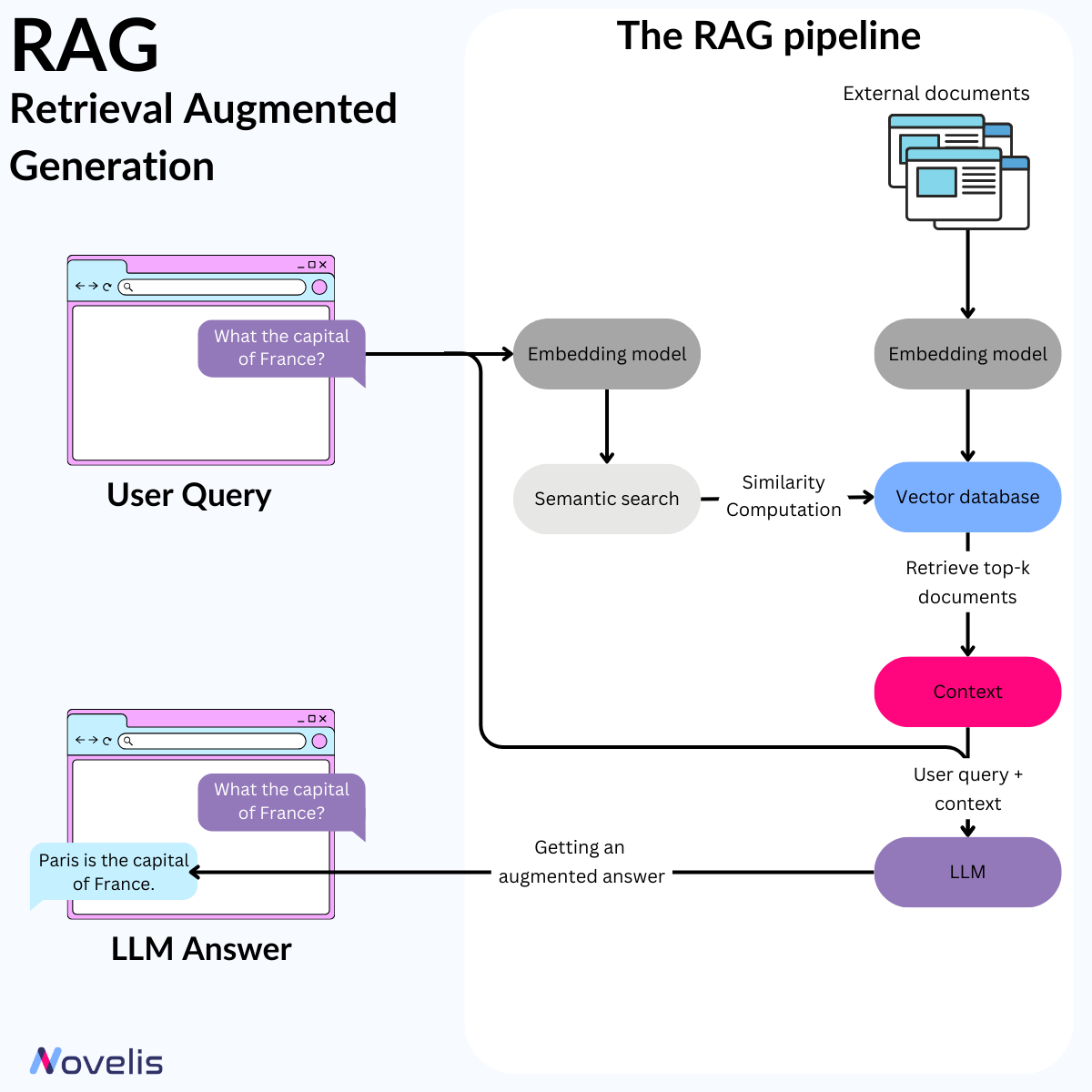

L’efficacité simple du Retrieval Augmented Generation (RAG)

L’intelligence artificielle progresse rapidement avec des modèles comme GPT-4, Mistral, et Llama qui fixent de nouveaux standards. Cependant, ces modèles restent limités par leurs connaissances internes. En septembre 2020, Meta AI a introduit le cadre RAG (Retrieval Augmented Generation), conçu pour améliorer les réponses des LLM en intégrant des sources de connaissance externes et en enrichissant leurs bases de données internes. RAG est un système d’IA qui combine les LLM avec des bases de données externes pour fournir des réponses précises et actualisées.

Pourquoi est-ce essentiel ? Les LLM sont souvent limités par des données obsolètes et peuvent générer des informations erronées. Le RAG résout ces problèmes en assurant une précision factuelle et une cohérence, réduisant la nécessité de réentraîner fréquemment les modèles. Cela permet de diminuer les ressources computationnelles et financières nécessaires au maintien des LLM.

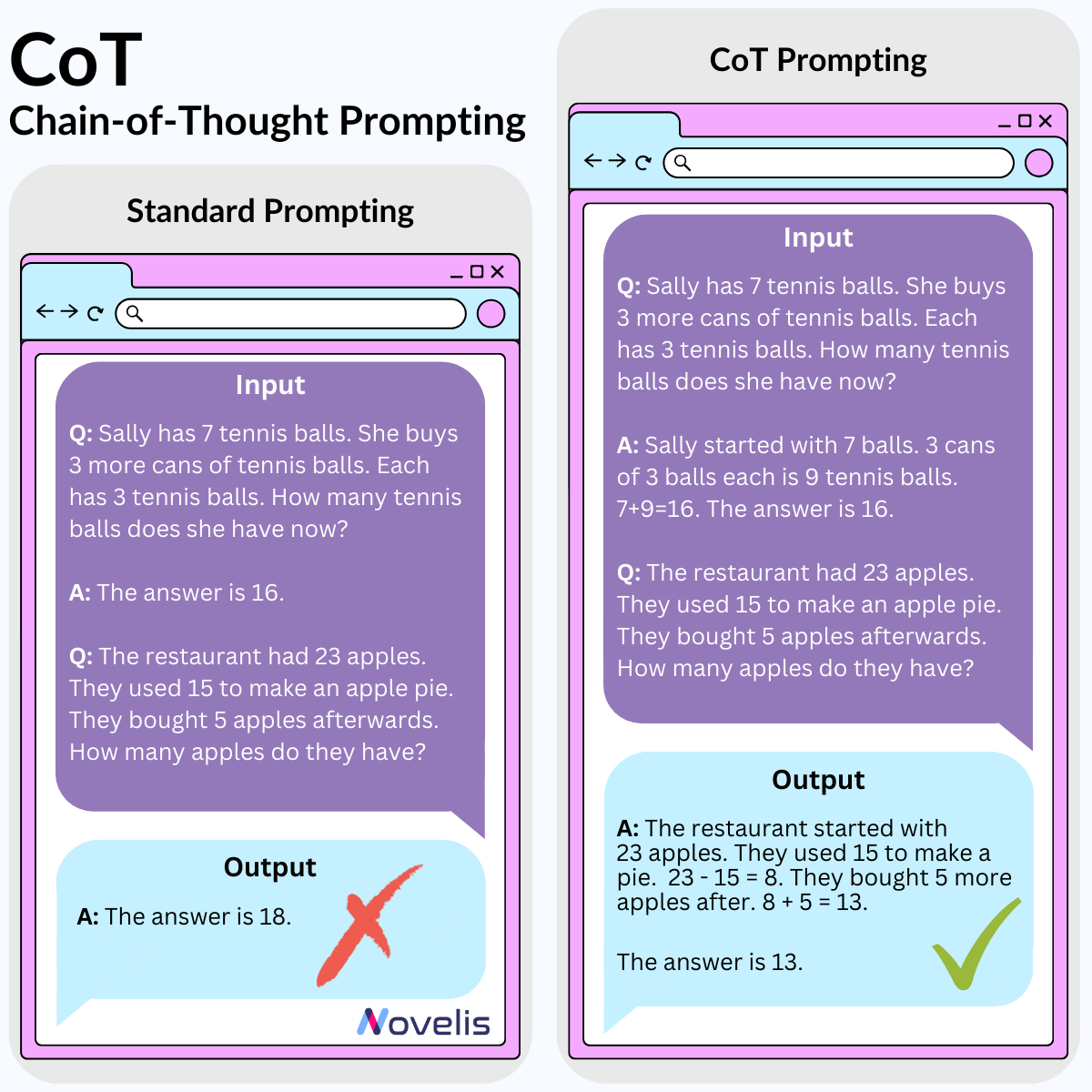

Chain-of-Thought : les LLM peuvent-ils raisonner ?

Nous avons exploré comment mieux utiliser les LLM grâce au Chain-of-Thought (CoT), une technique de prompt engineering. Cette méthode consiste à structurer les prompts de manière à décomposer un problème complexe en sous-problèmes plus simples, simulant la façon dont les humains résolvent les problèmes. Cela fonctionne bien pour des tâches de raisonnement arithmétique, de bon sens, et de logique symbolique.

Pourquoi est-ce essentiel ? Appliquer la technique CoT peut améliorer les résultats lorsqu’il s’agit de résoudre des problèmes arithmétiques, de bon sens ou de logique dans les LLM. Cela aide également à comprendre où le modèle pourrait se tromper

Le 30 avril, notre partenaire SS&C Blue Prism Live organise un événement à New York sur le thème de l’IA et de l’Automatisation.

C’est un événement clé pour les professionnels de la technologie désireux de comprendre et d’appliquer les principes de l’automatisation intelligente et de l’intelligence artificielle dans leurs domaines d’activité.

Novelis, en tant que sponsor, est fier de s’associer à cet événement qui promet de mettre en lumière les stratégies d’innovation les plus pertinentes de notre époque.

Cet événement mettra en avant des experts de différents secteurs qui partageront leur vision sur la manière dont l’intelligence artificielle et l’automatisation des processus métier peuvent transformer les organisations. Ces interventions ont pour but de démontrer comment l’exploitation stratégique des données et des technologies d’automatisation peut conduire à une efficacité opérationnelle accrue et à une meilleure prise de décision.

Novelis s’engage à promouvoir l’innovation dans les domaines de l’intelligence artificielle et de l’automatisation des processus. Notre participation à SS&C Blue Prism Live témoigne de notre volonté d’être à l’avant-garde des évolutions technologiques, en partageant notre expertise et en explorant de nouvelles voies pour accompagner les organisations dans leur transformation digitale.

En tant que partenaire engagé dans l’optimisation de la performance opérationnelle et la garantie de la pérennité des entreprises, nous proposons un vaste éventail de prestations. Au-delà des solutions d’automatisation avancée, notre offre inclut également des solutions sur mesure en IA Générative, conçues pour satisfaire des exigences de grande envergure. Notre équipe d’experts, composée notamment de docteurs et d’ingénieurs spécialisés en IA, en traitement automatique du langage naturel (NLP) et en IA Générative, est à votre disposition pour vous assister du concept initial jusqu’à la mise en œuvre d’applications à l’échelle de votre entreprise.

Pour plus d’informations, nous vous invitons à prendre contact avec nous.

Catherine Stewart – Présidente pour les Amériques, Walid Dahhane – CTO & Co-fondateur et Paul Branson – Directeur des solutions techniques, sont présents lors de l’événement SS&C Blue Prism Live à New York, le 30 avril 2024, et restent à votre disposition pour toute question.

Inscrivez-vous dès maintenant à l’événement pour explorer ensemble les possibilités offertes par ces technologies disruptives. Novelis est impatient de vous y retrouver pour échanger sur ces enjeux cruciaux.

Novelis annonce sa participation à la conférence trimestrielle SS&C Blue Prism en Grèce le 14 mars. Cet événement représente une étape importante pour Novelis, récemment honoré du statut de partenaire Gold.

Conçue pour un large public incluant des développeurs, des ingénieurs de processus, et des spécialistes en RPA et en automatisation intelligente, la conférence sert de centre de collaboration et d’innovation. Les participants prendront part à des discussions entre pairs, élargiront leurs réseaux et aborderont les défis de l’automatisation, partageant connaissances et stratégies pour améliorer l’efficacité opérationnelle.

Lors d’une session dédiée, Novelis présentera SmartRoby, sa plateforme de gouvernance de l’automatisation. Ina Krebs, Directrice Générale pour la région DACH & Nordiques, et Georges Abou Haidar, Chef de Produit et Architecte Solutions chez Novelis, partageront leurs perspectives sur la manière dont SmartRoby aide les entreprises à optimiser et rationaliser leurs opérations d’IA.

La conception de SmartRoby s’adresse à un large éventail d’utilisateurs, allant des PME et des COE, centres d’excellence, aux équipes de direction, offrant :

L’introduction de SmartRoby dans les organisations vise à améliorer la compréhension et le contrôle de leurs paysages d’automatisation, permettant ainsi aux équipes d’optimiser les opérations et de générer de meilleurs résultats en matière d’automatisation.

L’événement Live organisé par notre partenaire SS&C Blue Prism est un événement captivant et interactif d’une journée qui se concentre sur l’avenir de l’automatisation intelligente. En tant qu’acteur spécialisé dans les solutions et services intégrés, combinant notre expertise dans la gestion des processus avec l’automatisation intelligente et les innovations en matière d’IA, y compris l’IA Générative, nous sommes honorés de sponsoriser cet événement.

Tout au long de la journée, vous aurez l’occasion de participer à diverses conférences, présentées par des pionniers de l’industrie, qui vous donneront toutes les clés pour intégrer la RPA ou l’IA Générative, afin de déployer et d’optimiser des stratégies concrètes d’automatisation, dans vos processus au sein de votre organisation.

En tant que partenaire dédié à l’amélioration de l’efficacité opérationnelle des entreprises tout en assurant leur résilience future, nous offrons une large gamme de services. Ces services ne se limitent pas à des solutions d’automatisation intelligente, mais comprennent également des solutions d’IA Générative personnalisées conçues pour répondre à des besoins à grande échelle. Grâce à notre équipe d’experts, dont des docteurs et des ingénieurs spécialisés dans l’IA, le NLP et l’IA Générative, nous pouvons vous accompagner depuis le concept initial jusqu’au déploiement d’applications à l’échelle de l’entreprise.

Si vous souhaitez en savoir plus, n’hésitez pas à nous contacter. Notre équipe composée de Catherine Stewart – Présidente pour les Amériques, et Paul Branson – Directeur des solutions techniques, était sur place lors de l’événement SS&C Blue Prism Live le 27 février 2024 !

Durant l’événement, Paul Branson a pu s’exprimer lors d’un podcast sur comment Novelis intervient sur les processus métier de ses clients, qu’ils tentent de réinventer grâce à l’automatisation intelligente. Découvrez le podcast en replay de l’événement ! La session est en anglais.